この記事は、2026/2/23に公開された「Bring AI Models to Your Data with Cloudera AI Inference Service」の翻訳です。

AI 導入は新たな段階に入りました。企業の AI プロジェクトの 88% が実稼働前に行き詰まっていますが、これは考え方の詰めが甘かったり、モデルが脆弱だったりするからではありません。インフラストラクチャが追いつかないからです。クラウド API は急速に高額になり、ガバナンスは後回しにされ、遅延は積み重なります。また、規制の厳しい業界では、機密データをパブリックエンドポイントに移動することは、選択肢としてありえません。

AI パイロットと本格的な実稼働との間のギャップを埋めるには、インテリジェンスをソースに直接提供する必要があります。Cloudera AI Inference Service は、データが存在する場所で直接実行される、安全でパフォーマンスが高く、コスト効率の高い本番稼働モデルのサービスレイヤーをエンタープライズの組織に提供します。

Cloudera では、モデルのコンテキストとしてデータをクラウドに送信するのではなく、モデルをお客様の元にお届けします。そのため、必要な場所でインテリジェンスのブロックが解除され、設計の段階からデータは保護され、お客様独自のファイアウォール内で確実に拡張されます。

データに AI を導入することが重要な 3 つの理由:プライバシー、コスト、スケールに応じた選択

データのプライバシーと保護

ほとんどの AI サービスでは、データをクラウドに送信する必要があり、コンプライアンス、コスト、遅延に関するリスクが生じます。Cloudera では、データがすでに存在する場所にモデルを導入するというアプローチを取っています。セキュアな仮想プライベートクラウド(VPC)内、またはエアギャップ(完全にオフラインかつ孤立)されたオンプレミス環境内でも、このモデルツーデータ戦略により、情報のプライバシーとガバナンスが確保され、同時に高パフォーマンスの推論によって本番環境の AI を強化することができます。

長期的に予測可能な経済性

クラウド上で 24 時間 365 日 AI を運用すると、予測不能な費用が急増します。こういったリクエストごとの料金では、使用量に応じて変動する予算を組まねばならず、長期的に予測することが困難になります。組織がすでに所有および管理しているインフラストラクチャに推論を移行することで、チームはこれらの外部使用料を回避できます。AI が安定した実稼働状態に移行すると、コストを予測しやすくなり、ワークロードの拡大に応じて投資収益率が向上します。

コントロールと選択

ほとんどのクラウド AI プロバイダーは、顧客を独自のエコシステムに誘導しているため、モデルの切り替え、拡張、または完全な制御が困難になっています。Cloudera AI Inference Service では、知的財産の管理や所有権を放棄することなく、NVIDIA の Nemotron のようなオープンソースの GenAI LLM から従来の予測モデルまで、幅広い AI 機能を展開できます。Cloudera AI Inference サービスは、NVIDIA AI スタック(NVIDIA Blackwell GPU、NVIDIA Dynamo-Triton、高性能でスケーラブルなモデル提供のためのNVIDIA NIM マイクロサービス)によって加速され、AI インフラストラクチャの柔軟性、移植性、将来性を維持しながら、自由なイノベーションを可能にします。

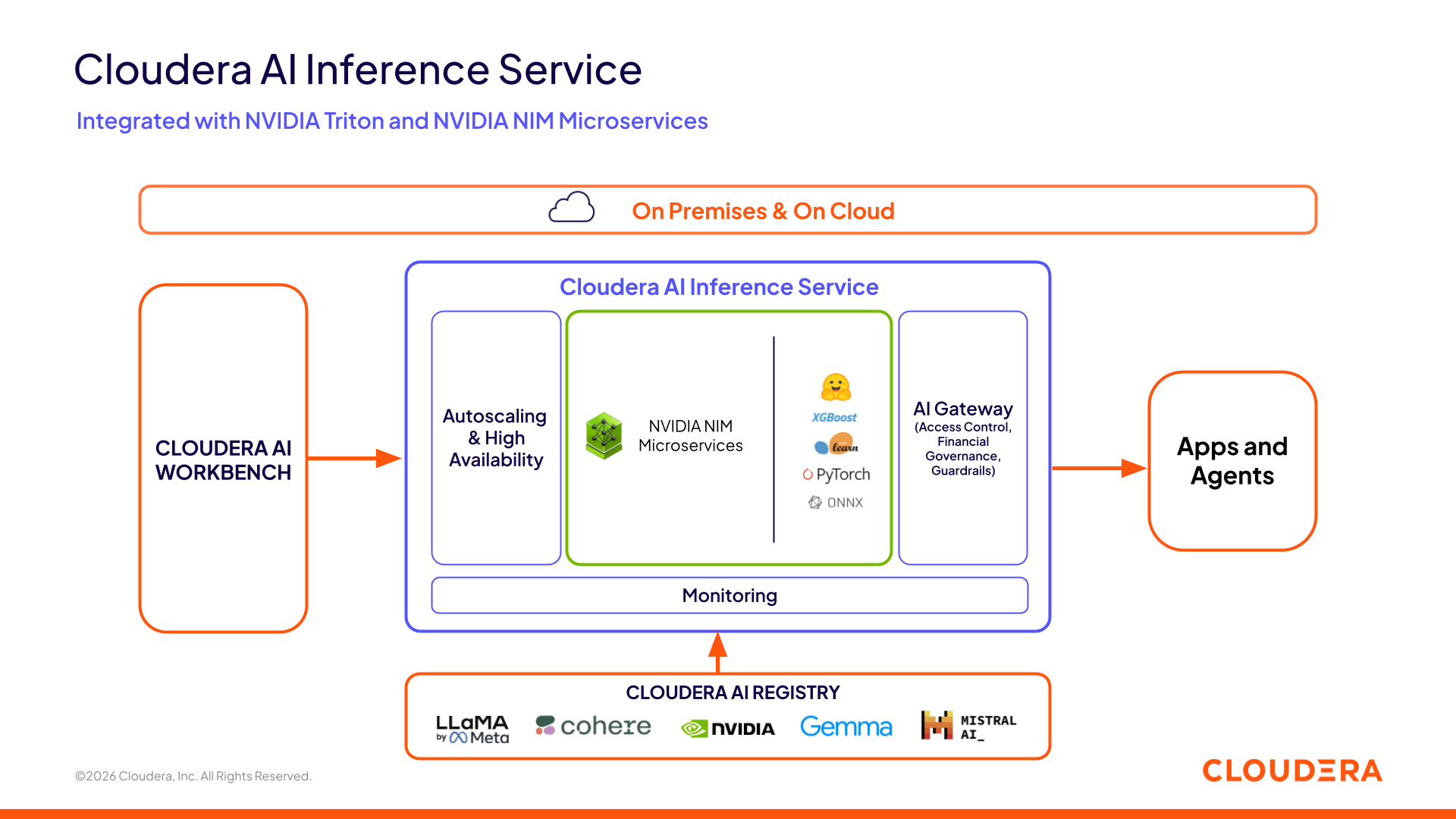

図 1:Cloudera AI Inference Service のアーキテクチャ

図 1:Cloudera AI Inference Service のアーキテクチャ

成功事例:オンプレミス対応 Cloudera AI Inference Service の早期導入

Cloudera AI Inference Service は、オフライン環境、ソブリンインフラストラクチャ、レイテンシーが重要となる運用など、クラウドが利用できない場所で新しい AI ユースケースを実現します。ここでは、Cloudera AI Inference Service によって実現され、早期導入を行った組織によってすでに実行されている 3 つの実際のシナリオをご紹介します。

国家安全保障:決して眠らず、漏洩もしない、隔離されたインテリジェンス

国防において、スピードと安全は譲れません。しかし最近まで、諜報員は機密性の高いオフライン文書を手作業で精査するのに何千時間も費やしており、プロセスによって遅延が生じ、量に圧倒され、公開されている AI ツールを漏洩のリスクなしに活用することができませんでした。

今では、Cloudera AI Inference Service がエアギャップ環境で稼働しているため、防衛機関は膨大な文書コレクションを数秒でスキャンして要約する強力な LLM アシスタントを配置できます。これらのモデルは完全にオフラインで動作します。インターネットがなく、クラウドに依存せず、データ漏洩もなく、アナリストはセキュリティを損なうことなく迅速な意思決定を行うことができます。

グローバルファイナンス:即時運用、データ漏洩ゼロ

国境を越えた金融には数十もの言語が存在します。以前は、契約書、不正報告書、コンプライアンス更新などの文書を翻訳する際には外部ツールを使用せざるを得ず、データ漏洩や監査可能性をめぐる深刻な懸念が生じていました。

現在、世界トップクラスのクレジットカードプロバイダーの 1 社が、Cloudera AI Inference Service を精査し、200 以上の市場でリアルタイムに機密通信を翻訳する多言語モデルのオンプレミス展開を完全な内部管理下でテストしています。自社のインフラストラクチャ上で推論を実行することで、内部運用の迅速化と顧客対応時間の短縮を実現し、同時にサードパーティーの API に伴うコンプライアンスリスクを回避しています。

公共部門:すべての従業員のための AI エージェント

政府機関は、より多くの人々に、より迅速にサービスを提供するというプレッシャーにさらされていますが、職員は時代遅れのポータルや分厚い政策マニュアルに頼っていることがよくあります。プライバシーの規定や予測不可能なコストのため、公共の生成 AI ツールは選択肢にはなりません。

Cloudera AI Inference Service の初期実装では、内部機関文書に基づいてトレーニングされたオンプレミスの AI チャットボットをサポートしています。これらのエージェントは、データ、プロンプト、出力を完全に制御しながら、スタッフと構成員が複雑なトピックを迅速かつ自信を持ってナビゲートし、即座に回答を提供するのに役立ちます。

将来を見据えて:AI の未来はデータが存在するあらゆる場所にある

Cloudera AI Inference Service は、お客様のデータが存在する場所にモデルを導入することで、予測可能なコストと幅広い実稼働モデルから選択できる柔軟性により、企業が独自の条件でインテリジェンスを拡張できるよう支援します。エアギャップ環境のセキュリティ要件に対応するためであれ、大量のグローバルオペレーションを最適化するためであれ、実稼働グレードの AI への道は今、開かれています。

Cloudera AI は、生成型 AI やエージェント型 AI から従来の機械学習まで、データ資産全体にわたってあらゆる種類の AI を構築、展開、管理するための信頼できる基盤です。

拡張する準備はできていますか?インフラストラクチャによって AI 戦略が制限されないようにしましょう。Cloudera AI Inference Service のウェブページでユースケースのデモをご覧いただけます。詳細を解説しているこちらのウェビナー (英語) もご利用いただけます。また、「あらゆる場面で AI を活用」する方法を説明するデモをご予約ください。