AI の開発とデプロイを推進しながら、AI ライフサイクルのあらゆる段階を保護します。

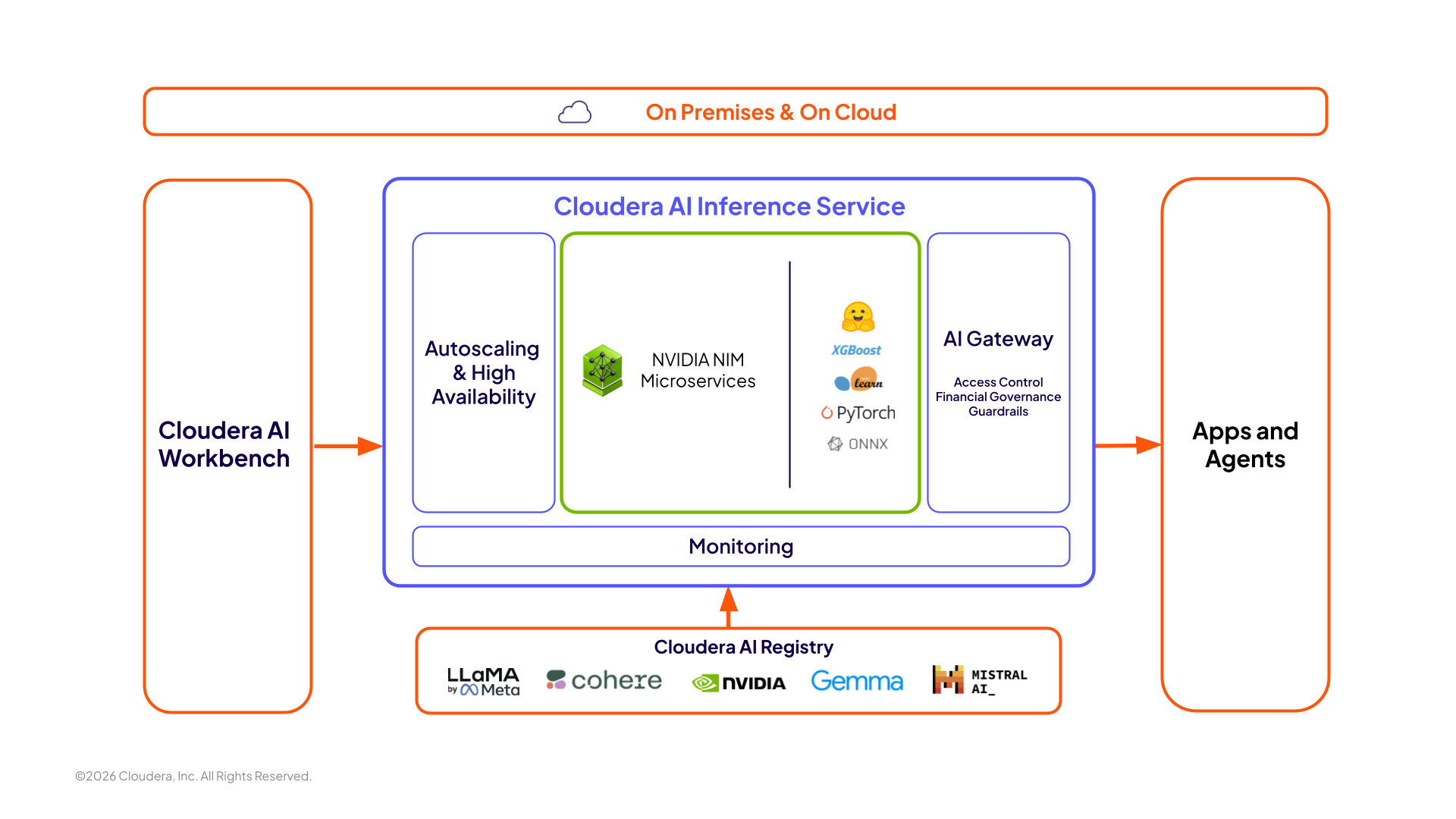

NVIDIA NIM マイクロサービスを搭載した Cloudera AI Inference サービスは、市場をリードするパフォーマンスを提供します。NVIDIA GPU で最大36倍高速な推論を、CPU で4倍近いスループットを実現することで、パブリッククラウドとプライベートクラウド全体で AI の管理とガバナンスをシームレスに効率化します。

単一のサービスでエンタープライズ AI 推論のあらゆるニーズに対応

ワンクリックでデプロイ: 環境に関係なく、モデルを開発段階から本番運用へ迅速に移行します。

単一のセキュアな環境: AI ライフサイクルのすべての段階をカバーする堅牢なエンドツーエンドのセキュリティを実現します。

単一のプラットフォーム: あらゆる AI ニーズに対応する単一のプラットフォームで、すべてのモデルをシームレスに管理できます。

ワンストップサポート: ハードウェアとソフトウェアに関するすべての質問に対して、Cloudera から統合的なサポートを受けられます。

AI Inference サービスの主な特長

AI Inference サービスの導入オプション

パフォーマンス、セキュリティ、統制を損なうことなく、オンプレミスまたはクラウドで推論ワークロードを実行します。

クラウドの Cloudera

- マルチクラウドの柔軟性: 複数のパブリッククラウドに展開し、特定のエコシステムへのロックインを回避できます。

- 価値実現までの時間を短縮: インフラストラクチャーをセットアップすることなく、推論を開始できます。迅速な実験に最適です。

- エラスティックな拡張性: scale-to-zero 対応の自動拡張と GPU に最適化されたマイクロサービスにより、予測不能なトラフィックにも対応します。

オンプレミスの Cloudera

- データ主権: 完全な統制を維持します。モデル、プロンプト、資産がファイアウォール内に完全に保持されます。

- エアギャップ対応: 政府、医療、金融サービスなど、規制の厳しい環境向けに構築されています。

- 予測可能で低い TCO: 固定価格によりコストの予期せぬ増加を防ぎ、トークンベースのクラウド API と比べて TCO を抑えられます。

容易なモデルのデプロイを体験

Cloudera の強力なツールを使用して大規模言語モデルを簡単にデプロイし、AI アプリケーションを大規模かつ効果的に管理する方法をご覧ください。

モデルレジストリの統合:

一元化された Cloudera AI Registry リポジトリを使用して、モデルへのアクセス、モデルの保存、バージョン管理、モデルの管理などをシームレスに実行できます。

簡単な設定とデプロイ: クラウド環境全体にモデルをデプロイし、エンドポイントを設定し、自動拡張機能を調整して、効率を高めることができます。

パフォーマンス監視:

レイテンシ、スループット、リソースの使用率、モデルの健全性などの主要なメトリクスに基づいて、トラブルシューティングと最適化を実行できます。